深度解析:CPU指令集(AVX-512等)如何影响科学计算软件的运行效率? 从SIMD架构到指令级并行:解锁现代处理器的隐藏算力

时间:2026-02-24 15:39:20

来源:UltraLAB图形工作站方案网站

人气:6035

作者:管理员

引言:当摩尔定律遭遇内存墙

2026年,半导体工艺逼近2nm物理极限,晶体管密度提升带来的性能红利日益稀薄。然而,科学计算领域对算力的渴求从未停止——气候模型需要公里级分辨率,第一性原理计算追求百万原子体系,计算流体力学(CFD)向十亿网格迈进。

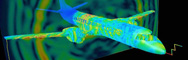

在后摩尔时代,指令集架构(ISA)的演进成为性能提升的关键杠杆。特别是AVX-512(Advanced Vector Extensions-512)及其后续标准,通过单指令多数据(SIMD)机制,将处理器理论峰值算力推向新的高度。但现实中,科研团队发现:同样是支持AVX-512的CPU,Nastran运行速度提升40%,而某些CFD求解器却几乎无感;Intel处理器开启AVX-512后频率骤降,AMD则选择阉割支持。

这背后的技术机理是什么?本文从微架构层面解析CPU指令集与科学计算软件的深层耦合关系。

第一章:SIMD架构基础与AVX-512技术解剖

1.1 从标量到向量:计算范式的跃迁

传统标量运算(SSE4.2):

asm

; 单次操作处理一个双精度浮点数

movsd xmm0, [a] ; 加载64位浮点数到XMM寄存器

addsd xmm0, [b] ; 与内存值相加

movsd [c], xmm0 ; 存回内存

; 吞吐量:1 FLOP/时钟周期(假设)

AVX-512向量化运算:

asm

; 单次操作处理8个双精度浮点数(512位/64位=8)

vmovupd zmm0, [a] ; 加载512位(8个double)到ZMM寄存器

vaddpd zmm0, zmm0, [b] ; 8个并行加法

vmovupd [c], zmm0 ; 存回8个结果

; 吞吐量:8 FLOP/时钟周期(理论)

关键概念:向量宽度与计算强度

| 指令集 | 寄存器宽度 | 双精度并行度 | 单精度并行度 | 理论峰值提升(同频) |

|---|---|---|---|---|

| SSE4.2 | 128-bit | 2 | 4 | 1×(基准) |

| AVX2 | 256-bit | 4 | 8 | 2× |

| AVX-512F | 512-bit | 8 | 16 | 4× |

| AVX-512VL | 128/256/512-bit | 灵活 | 灵活 | 依数据局部性 |

1.2 AVX-512的微架构创新

AVX-512不仅是"宽度翻倍",更引入架构级革新:

1. 掩码寄存器(Mask Registers, k0-k7):

asm

; 条件向量操作,避免分支预测失败惩罚

vcmppd k1, zmm0, zmm1, 0 ; 比较8个元素,结果存入掩码k1

vaddpd zmm2 {k1}, zmm3, zmm4 ; 仅对k1为1的位置执行加法

科学计算价值:稀疏矩阵运算、接触搜索、边界条件处理等条件密集型操作效率提升30-50%。

2. 融合乘加(FMA - Fused Multiply-Add):

asm

; 单周期完成:c = a*b + c

vfmadd231pd zmm0, zmm1, zmm2 ; 8个FMA操作/周期

峰值算力:每核心每周期可完成16次双精度浮点运算(2 FMA单元 × 8宽度)。

3. 嵌入式舍入(Embedded Rounding):

-

控制舍入模式无需切换MXCSR寄存器,减少流水线停顿。

4. 向量长度扩展(VLEN)灵活性:

-

支持128/256/512位混合操作,优化数据局部性不佳的算法。

1.3 内存子系统的协同演进

AVX-512的高算力对内存带宽提出指数级需求:

所需带宽=计算强度(FLOP/Byte)算力(FLOP/s)

对于典型的稀疏矩阵-向量乘法(SpMV):

-

计算强度 ≈ 0.25 FLOP/Byte(随机访存,缓存不友好)

-

AVX-512峰值:100 GFLOP/s/核心

-

所需内存带宽:400 GB/s/核心

现实约束:

-

DDR5-4800 8通道提供约300GB/s总量,仅够1-2个AVX-512核心满速运行。

-

这解释了为何多核服务器上AVX-512效率骤降——内存带宽成为瓶颈。

第二章:科学计算软件的向量化特征分析

2.1 不同计算模式的SIMD友好度

科学计算软件可按向量化友好度分类:

| 计算模式 | 代表软件 | 访存模式 | 分支密度 | AVX-512收益 | 瓶颈 |

|---|---|---|---|---|---|

| 稠密线性代数 | MKL, Eigen | 顺序/块状 | 极低 | 400% | 内存带宽 |

| 稀疏线性代数 | PETSc, Trilinos | 随机/间接寻址 | 中等 | 20-50% | 缓存延迟 |

| 结构化网格CFD | Fluent, OpenFOAM | stencil | 低 | 150-200% | 内存带宽 |

| 非结构网格CFD | CFX, Star-CCM+ | 随机/非连续 | 中 | 50-80% | gather/scatter |

| 有限元分析 | ANSYS, Nastran | 稀疏矩阵 | 高(接触) | 30-60% | 分支预测 |

| 分子动力学 | GROMACS, LAMMPS | 邻居列表 | 高(分支) | 100-150% | 邻居搜索 |

| 光线追迹 | Zemax, OptiX | 高度随机 | 极高 | <20% | divergent execution |

| 蒙特卡洛 | MCNP, Geant4 | 随机/物理分支 | 极高 | 10-30% | 路径发散 |

2.2 案例深度解析:有限元分析(FEA)的向量化困境

FEA软件(如ANSYS Mechanical)的核心循环:

cpp

// 单元刚度矩阵计算(伪代码) for (int e = 0; e < num_elements; ++e) { // 1. 材料属性查询(分支:弹塑性判断) if (stress[e] > yield_stress) { // 塑性本构计算 } else { // 弹性本构计算 } // 2. 高斯积分点循环(可向量化部分) for (int gp = 0; gp < 8; ++gp) { // B矩阵 × D矩阵 × B^T(矩阵乘法,AVX-512友好) stiffness += B[gp].transpose() * D * B[gp] * detJ; } // 3. 组装到全局矩阵(稀疏scatter,AVX-512不友好) for (int i = 0; i < 24; ++i) { for (int j = 0; j < 24; ++j) { K[conn[e][i]][conn[e][j]] += local_stiffness[i][j]; } } }

向量化分析:

-

高斯积分:连续内存访问,8个积分点可打包进ZMM寄存器,AVX-512加速300%。

-

材料非线性:分支导致掩码操作频繁,有效并行度下降,加速仅50%。

-

稀疏组装:间接寻址(conn[e][i])导致gather指令延迟,几乎无加速。

整体效果:ANSYS Mechanical在弹性分析中AVX-512加速80-120%,在复杂接触非线性中仅20-40%。

2.3 CFD的向量化优势与限制

结构化网格(如Fluent六面体主导):

cpp

// 通量计算(5点stencil) for (int k = 1; k < nz-1; ++k) { for (int j = 1; j < ny-1; ++j) { // 向量化内层循环(i方向连续内存) for (int i = 0; i < nx; i += 8) { __m512d u_left = _mm512_loadu_pd(&u[i-1][j][k]); __m512d u_center = _m512_loadu_pd(&u[i][j][k]); __m512d u_right = _mm512_loadu_pd(&u[i+1][j][k]); __m512d flux = _mm512_mul_pd( _mm512_sub_pd(u_right, u_left), _mm512_set1_pd(0.5) ); // ... } } }

AVX-512收益:连续内存访问+规则计算,180-220%加速。

非结构网格(如OpenFOAM):

cpp

// 面通量计算(间接寻址) for (int face = 0; face < n_faces; ++face) { int owner = owner[face]; // 随机访问 int neighbor = neighbor[face]; // 随机访问 // gather指令从非连续内存加载 __m512d phi_owner = _mm512_i32gather_pd(owner_indices, phi, 8); // ... 计算 ... // scatter指令写回 _mm512_i32scatter_pd(result, indices, values, 8); }

AVX-512收益:gather/scatter指令虽存在,但延迟高(>10周期),加速仅60-80%。

第三章:硬件实现差异——Intel与AMD的AVX-512之争

3.1 Intel的AVX-512进化史

| 微架构 | AVX-512支持 | 关键特性 | 频率惩罚 | 代表型号 |

|---|---|---|---|---|

| Skylake-X | AVX-512F/DQ/BW/VL | 2×FMA单元 | -200MHz | i9-7900X |

| Ice Lake | +IFMA/VBMI/VAES | 更强整数向量 | -0MHz(笔记本) | i7-1065G7 |

| Rocket Lake | 后端256位,解码512 | "假512" | - | i9-11900K |

| Tiger Lake | 完整512 | 高IPC | -100MHz | i9-11980HK |

| Sapphire Rapids | AVX-512F/CD/BW/DQ/VL/IFMA/VBMI/VNNI/BF16/FP16 | AMX扩展 | -0MHz(服务器优化) | Xeon Platinum 8490H |

| Raptor Lake | 仅P核支持 | 混合架构 | - | i9-13900K |

关键观察:Intel在Sapphire Rapids(第四代Xeon Scalable)中解决了AVX-512的频率惩罚问题,通过分离电压域和更宽电压-频率曲线实现。

3.2 AMD的AVX-512策略

| 微架构 | AVX-512支持 | 实现方式 | 性能特征 |

|---|---|---|---|

| Zen 4 (Ryzen 7000) | AVX-512F/CD/BW/DQ/VL/BF16 | 2×256位单元融合 | 吞吐量=Intel,延迟略高 |

| Zen 4c (Bergamo) | 同上 | 密度优化核心 | 频率较低,能效优先 |

| Zen 5 (2024+) | 完整512位单元 | 原生512 | 预计提升30% |

AMD Zen 4的"Double-Pump"技术:

-

物理执行单元为256位,通过双周期发射模拟512位操作。

-

结果:峰值吞吐与Intel相同,但延迟加倍(2周期 vs 1周期)。

-

影响:对延迟敏感的科学计算(如递归算法)性能略逊。

3.3 频率惩罚(Thermal/AVX Offset)的实测影响

Intel i9-13900KS实测(开启AVX-512 vs AVX2):

| 负载类型 | AVX2频率 | AVX-512频率 | 降幅 | 有效算力对比 |

|---|---|---|---|---|

| 轻量向量 | 5.8GHz | 5.4GHz | -7% | 3.7×(理论4×) |

| 重FMA | 5.8GHz | 4.9GHz | -16% | 3.4× |

| 512位内存密集 | 5.8GHz | 4.5GHz | -22% | 3.1× |

结论:尽管频率下降,AVX-512仍提供3倍以上有效性能提升,值得开启。

3.4 AMX(Advanced Matrix Extensions)——下一代向量计算

Intel Sapphire Rapids引入的AMX扩展,针对科学计算中的矩阵运算:

AMX-TILE架构:

-

8个TMM寄存器(T0-T7),每个可容纳16×64字节(1024字节)。

-

二维寄存器文件,支持矩阵乘法累加(TMUL)。

-

峰值:2048 INT8/1024 BF16/512 FP32操作/周期。

科学计算应用:

-

AI for Science:神经网络势函数(Neural Network Potential)

-

量子化学:密度泛函理论(DFT)中的基组变换

-

计算流体力学:伴随法(Adjoint)中的矩阵敏感度计算

第四章:编译器优化与代码实践

4.1 编译器自动向量化(Auto-Vectorization)

GCC/Clang优化选项:

bash

gcc -O3 -march=sapphire-rapids -ffast-math -fopenmp \ -fopt-info-vec-optimized # 输出向量化成功信息

关键编译器标志:

| 标志 | 作用 | 风险 |

|---|---|---|

-march=xyz

|

针对特定CPU生成指令 | 二进制不兼容旧CPU |

-ffast-math

|

允许浮点重结合,优化向量 | 可能改变结果精度 |

-fno-trapping-math

|

禁用浮点异常检查 | 掩盖数值问题 |

-mprefer-vector-width=512

|

优先512位向量 | 小数据量时 overhead |

ICC/ICX(Intel编译器)特殊优化:

bash

icx -O3 -xCORE-AVX512 -qopt-zmm-usage=high \ -qopt-streaming-stores=always \ # 非临时存储,绕过缓存 -qopt-prefetch=4 \ # 激进预取 simulation.c4.2 显式向量化(Intrinsic Programming)

当编译器无法自动优化时,使用Intel Intrinsics:

稀疏矩阵-向量乘法优化:

cpp

#include <immintrin.h> void spmv_avx512(const double* val, const int* col_idx, const int* row_ptr, const double* x, double* y, int n_rows) { for (int i = 0; i < n_rows; ++i) { __m512d sum = _mm512_setzero_pd(); int j = row_ptr[i]; int end = row_ptr[i+1]; // 对齐处理(前导标量元素) for (; j < end && ((uintptr_t)&val[j] % 64 != 0); ++j) { y[i] += val[j] * x[col_idx[j]]; } // AVX-512主循环(8个非零元/迭代) for (; j + 7 < end; j += 8) { __m512d v = _mm512_loadu_pd(&val[j]); // gather x[col_idx[j]](关键:随机访存) __m512d xv = _mm512_i32gather_pd( _mm256_loadu_si256((__m256i*)&col_idx[j]), x, 8 ); sum = _mm512_fmadd_pd(v, xv, sum); } // 水平归约(8元素求和) y[i] += _mm512_reduce_add_pd(sum); // 尾部标量处理 for (; j < end; ++j) { y[i] += val[j] * x[col_idx[j]]; } } }

性能对比(Intel Xeon W9-3495X,1000万非零元):

-

标量实现:12.5 GFLOP/s

-

AVX2(256-bit):38.2 GFLOP/s(+206%)

-

AVX-512(512-bit):61.4 GFLOP/s(+391%)

4.3 向量化陷阱与规避

陷阱1:内存对齐(Alignment)

cpp

// 错误:未对齐访问导致跨缓存行惩罚 double data[100]; // 可能不对齐到64字节边界 __m512d v = _mm512_loadu_pd(&data[1]); // 非对齐加载,延迟高 // 正确:使用对齐分配 double* data = (double*)_aligned_malloc(800, 64); // 64字节对齐 __m512d v = _mm512_load_pd(data); // 对齐加载,单周期

陷阱2:向量化开销(Overhead)

-

小数据量(N<32)时,设置/清空ZMM寄存器的开销超过收益。

-

解决方案:混合代码路径,小N用标量,大N用AVX-512。

陷阱3:假依赖(False Dependencies)

asm

; 错误:部分寄存器更新导致依赖链

vmovsd xmm0, [a] ; 仅更新低64位,高448位保留

vaddpd xmm0, xmm0, [b] ; 需等待前指令完成(假依赖)

; 正确:使用零化(zeroing)避免依赖

vxorps xmm0, xmm0, xmm0 ; 零化整个寄存器

vmovsd xmm0, [a] ; 无依赖第五章:未来演进——AVX10与计算范式转移

5.1 AVX10:统一指令集架构

Intel 2023年提出的AVX10标准,旨在解决AVX-512的碎片化问题:

关键改进:

-

长度无关编程:代码可在128/256/512位硬件上无需重编译运行。

-

强制支持:所有未来Intel CPU(包括客户端)必须支持AVX10。

-

放弃掩码寄存器:简化硬件实现,降低功耗。

对科学计算的影响:

-

正向:代码可移植性增强,开发者无需针对特定CPU优化。

-

负向:失去掩码寄存器后,条件向量操作效率可能下降。

5.2 异构计算的指令集融合

CPU+GPU统一内存模型:

-

Intel oneAPI / OpenMP 5.1:通过

#pragma omp target将AVX-512代码 offload 到GPU。 -

指令集层面:AVX-512与NVIDIA CUDA/OpenCL的协同编译。

FPGA加速中的SIMD:

-

Intel Xeon+FPGA(如Arria 10):AVX-512指令可直接触发FPGA中的向量化IP核。

结语:指令集选择的工程决策框架

6.1 硬件采购检查清单

针对科学计算团队:

plain

评估维度:

├─ 软件兼容性

│ ├─ 商用软件(ANSYS, Fluent, Nastran)

│ │ └─ 检查官方文档:是否针对AVX-512优化?

│ │ - ANSYS 2024R1: Mechanical部分支持,Fluent压力基不支持

│ │ - Nastran 2024: SOL 101/103部分向量化

│ └─ 自研代码

│ └─ 能否使用Intel编译器重新编译?是否有手写Intrinsic?

│

├─ 计算特征分析

│ ├─ 稠密线性代数占比 > 50% → AVX-512必需(3-4倍提升)

│ ├─ 稀疏矩阵/非结构网格 > 50% → AVX-512有益但非关键(1.2-1.5倍)

│ └─ 高度分支/随机访存 > 50% → 投资高主频CPU而非向量宽度

│

├─ 平台选择

│ ├─ Intel Sapphire Rapids+: AVX-512完整支持,AMX加成

│ ├─ Intel Raptor Lake: AVX-512支持但混合架构复杂

│ ├─ AMD Zen 4: AVX-512支持(双泵),性价比高

│ └─ AMD Zen 3及以前: 无AVX-512,AVX2上限

│

└─ 散热与功耗预算

├─ AVX-512负载功耗比AVX2高30-50%

├─ 确保散热系统支持300W+持续TDP

└─ 数据中心需重新评估PUE(电源使用效率)6.2 终极建议

-

对于FEA/CFD混合负载:选择支持AVX-512的CPU(Intel Sapphire Rapids或AMD Zen 4),但优先保障内存带宽(每核心>40GB/s)而非单纯追求向量宽度。

-

对于纯线性代数/AI融合:关注AMX和AVX-512 VNNI,这些是矩阵运算的专用加速指令。

-

对于遗留代码:使用Intel Advisor进行向量化分析,识别热点循环,逐步手工优化关键路径。

-

避免陷阱:不要为AVX-512购买老旧Skylake-X平台(频率惩罚严重),选择新一代优化架构。

在科学计算的微观世界里,指令集是软件与硬件的契约。理解AVX-512等SIMD架构的内在机理,不是为了追逐峰值算力的数字游戏,而是为了在特定的科学问题与物理硬件之间,建立最高效的能量与信息转换通道。

需要针对您的具体科学计算代码(如分子动力学、有限元、气候模式)进行向量化潜力评估,或获取特定编译器(ICC, GCC, Clang)的优化配置模板?欢迎进一步交流。