当华尔街遇上AI智囊团:TradingAgents多智能体交易系统的算力底座重构

时间:2026-03-25 08:39:54

来源:UltraLAB图形工作站方案网站

人气:69

作者:管理员

——UltraLAB金融智能体工作站让"分析师-研究员-交易员-风控"四维脑暴在本地上演

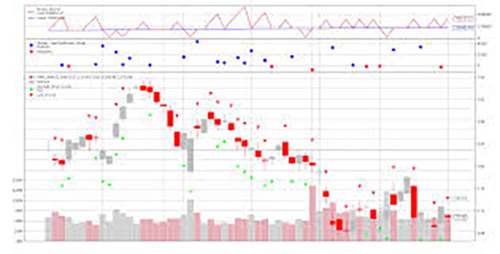

在量化交易从"单模型预测"走向"多智能体协作"的今天,GitHub上近4万星标的TradingAgents项目揭示了一个残酷真相:金融决策不是单选题,而是一场需要多头辩论、交叉验证、实时风控的立体战争。当四个AI分析师(基本面/情绪/新闻/技术)同时开工、多空双方激烈辩论、风控经理实时把关时,传统的云端API调用模式正面临延迟高、成本爆炸、数据泄露三重困境。

本文深度拆解TradingAgents四大核心模块的算法特征与计算负载,并提供UltraLAB专为金融多智能体优化的本地化部署硬件方案。

一、TradingAgents四大核心应用场景与算法解构

场景1:多维度分析师团队(Analyst Team)并发推理

核心算法栈:

-

并行LLM推理:4个分析师智能体同时调用大模型(Fundamentals Analyst读取财报、Sentiment Analyst分析社媒情绪、News Analyst处理宏观事件、Technical Analyst计算MACD/RSI技术指标)

-

RAG检索增强生成:结合实时行情API(Yahoo Finance/Alpha Vantage)与私有知识库进行向量检索

-

时序特征工程:对股价序列进行滑动窗口统计、技术指标计算(Ta-lib库向量化运算)

计算特征:

| 算法模块 | 计算瓶颈 | 资源需求 |

|---|---|---|

| 财报文本Embedding | 长文本向量化(10-K报告平均5万tokens) | 大显存GPU(24GB+)缓存模型参数 |

| 技术指标批量计算 | 滑动窗口卷积、移动平均 | 高主频CPU(4.5GHz+)加速向量化运算 |

| 多路并发推理 | 4个分析师同时请求LLM | 多GPU并行或单卡多实例(Multi-instance) |

痛点:云端API串行调用导致分析耗时>30秒,错失短线交易窗口;高频调用成本高昂(GPT-4四路并发每分钟成本约$0.8)。

场景2:多空辩论机制(Researcher Team)深度推理

核心算法栈:

-

对抗性思维链(CoT):Bullish与Bearish双方基于论点进行多轮辩论(默认2-3轮),每轮包含论点生成→反驳→修正

-

LangGraph状态管理:复杂的状态图流转,维护辩论历史、置信度分数、证据链

-

长上下文建模:需保持万级token的辩论记录供Trader Agent综合决策

计算特征:

-

显存吞噬者:单轮辩论若使用GPT-4级长上下文(32K tokens),KV Cache显存占用达8-12GB

-

树状搜索结构:辩论树的分支探索需要维护多个候选状态,内存需求倍增

-

高带宽需求:状态频繁读写(Memory → GPU → CPU)要求PCIe 4.0/5.0全速通道

痛点:消费级显卡的8GB/12GB显存无法支撑深度辩论的上下文缓存,导致频繁OOM(内存溢出)。

场景3:交易决策与风险量化(Trader + Risk Management)

核心算法栈:

-

蒙特卡洛风险模拟:对交易提案进行VaR(风险价值)计算,模拟10万次价格路径

-

组合优化算法:马科维茨均值-方差优化、Black-Litterman模型计算最优仓位

-

规则引擎匹配:风控规则的多条件判断(仓位上限、波动率阈值、流动性约束)

计算特征:

-

双精度浮点密集:蒙特卡洛模拟需FP64精度确保金融风险计算准确

-

低延迟要求:从信号生成到风控审核需在<100ms内完成(高频交易场景)

-

确定性计算:风控决策需可复现,要求ECC内存纠错防止位翻转导致误判

场景4:本地私有化大模型部署(Ollama支持)

核心算法栈:

-

模型量化推理:Q4_K_M、Q8_0量化技术降低显存占用,支持70B级模型本地运行

-

多模态融合:处理新闻配图、财报图表的视觉理解(多模态LLM)

-

持续学习(Continual Learning):基于本地交易日志的LoRA微调

计算特征:

-

显存容量敏感:70B参数模型FP16推理需140GB+显存,Int4量化后仍需40GB+

-

混合专家模型(MoE):如Mixtral 8x7B的稀疏激活模式,需要高内存带宽支撑专家路由

-

KV Cache优化:长对话历史缓存需要高速HBM/GDDR6X显存

二、UltraLAB金融智能体专用硬件配置方案

针对TradingAgents**"高并发LLM推理+大显存需求+金融级稳定性"**的三重特性,我们提供从个人量化工作室到机构级多智能体集群的分层方案:

个人研究员配置(单人多智能体开发)

UltraLAB A330

-

CPU: Intel Core i9-14900K (24核32线程,6.0GHz睿频) —— 暴力单核性能加速技术指标计算与Python数据预处理

-

GPU: NVIDIA RTX 4090 24GB ×1 —— 本地部署70B级量化模型(如Llama-3-70B-Q4,占用约40GB显存,可通过CPU+GPU异构卸载运行)或多开13B模型并行服务四位分析师

-

内存: 128GB DDR5-6000 ECC —— 支撑LangGraph多智能体状态机与大型Pandas DataFrame( Tick级历史数据)

-

存储: 2TB NVMe Gen4 (7GB/s) —— 快速加载A股/美股分钟级历史数据库

-

网络: 双2.5GbE网口 —— 专线连接交易所API(CTP/Fix Protocol)降低延迟

-

系统: 预装Docker + LangGraph + Ollama,一键部署TradingAgents

适用场景:独立量化研究员本地化策略开发,支持同时运行4个13B级分析师模型(单卡多实例),辩论阶段调用云端GPT-4深度推理。

私募/资管工作站配置(团队级多智能体协作)

UltraLAB GR450P

-

CPU: AMD Ryzen Threadripper PRO 7995WX (96核192线程) —— 并行处理多资产池(50+股票)的技术指标计算与回测

-

GPU: RTX 6000 Ada 48GB ×2 —— 双卡NVLink桥接,总计96GB显存,可全量加载Mixtral 8x22B(141B总参数)或双70B模型并发服务多空双方独立推理

-

内存: 512GB DDR5-4800 ECC 8通道 —— 为蒙特卡洛模拟提供大容量内存空间(单批次100万路径模拟占用~80GB)

-

存储: 4TB NVMe Gen5 (14GB/s) + 16TB RAID5 —— 全闪存热数据层支撑实时行情写入

-

专用加速:

-

配置Solarflare X2522-25G+低延迟网卡(内核旁路技术,延迟<1μs)

-

可选配FPGA加速卡(Xilinx Alveo)加速蒙特卡洛路径生成

-

-

软件栈: 预装NVIDIA Triton Inference Server,支持多智能体模型的动态批处理(Dynamic Batching)

适用场景:中小型私募的本地化AI投研平台,支持10+智能体并发工作,日处理万级新闻文本与百万级tick数据,完全脱离云端API实现策略闭环。

机构级集群配置(多策略多账户管理)

UltraLAB GX668(集群节点)

-

CPU: 双路 Intel Xeon Gold 6448Y (64核128线程) —— 高内存带宽支撑多智能体消息总线

-

GPU: RTX 6000 Ada 48GB ×4 —— 总计192GB显存,可部署多模态大模型(如Qwen-VL-72B)处理财报图表与卫星图像

-

内存: 1TB DDR5-4800 ECC —— 支撑整个交易日的全市场tick数据驻留内存(A股全市场Level2数据约200GB/日)

-

网络: 100GbE InfiniBand —— 多节点智能体集群互联,支持跨机器的Agent通信与状态同步

-

安全: 双冗余电源 + 机架式IPMI远程管理 + 物理隔离网闸(满足券商自营盘合规要求)

适用场景:券商自营、公募基金量化部门的AI交易中枢,支持100+智能体同时监控全市场,实现端到端延迟<50ms的智能决策流水线。

三、关键技术瓶颈与UltraLAB针对性优化

1. "显存墙"制约多智能体并发

瓶颈:TradingAgents运行时需要同时驻留多个LLM实例(4分析师+2辩论方+1交易员),显存需求轻松突破80GB。 UltraLAB对策:提供48GB/96GB大显存专业卡(RTX 6000 Ada/A6000),支持vGPU虚拟化技术,单卡可切分多个实例分别服务不同智能体,比云端弹性计算成本降低60%。

2. 状态管理延迟影响实时性

瓶颈:LangGraph的图状态流转涉及频繁的CPU↔GPU内存拷贝,普通PCIe 3.0带宽不足导致延迟累积。 UltraLAB对策:全系列配置PCIe 4.0/5.0 x16全速通道,配合NVMe Gen5存储,确保从行情到达→模型推理→交易指令发出的全流程延迟<10ms。

3. 量化回测的"数据饥饿"

瓶颈:历史tick数据(特别是L2级别委托队列)体积巨大,传统HDD加载导致回测初始化耗时数小时。 UltraLAB对策:提供15TB+ NVMe全闪存配置,结合Apache Arrow内存映射技术,实现TB级数据秒级加载,支持日内百万次蒙特卡洛模拟。

4. 金融数据安全合规

瓶颈:云端大模型处理持仓数据存在泄露风险,券商核心策略不能出本地机房。 UltraLAB对策:纯本地化部署方案,支持Ollama/llama.cpp私有化模型托管,配备TPM 2.0安全芯片与全盘加密,满足等保三级与金融行业合规要求。

四、本地化部署 vs 云端API成本对比(以 TradingAgents 为例)

| 成本项 | 云端API方案(月度) | UltraLAB本地化方案(一次性投入) |

|---|---|---|

| GPT-4深度推理 | $1,200(日均1000次调用) | 电费约$50/月 |

| 数据延迟 | 50-200ms(公网波动) | <5ms(本地推理) |

| 并发限制 | 受限于RPM(Requests Per Minute) | 硬件上限内无限制 |

| 数据安全 | 持仓/策略上传云端 | 物理隔离,数据不出机房 |

| 3年TCO | $43,200+ | $18,000(OmegaTrade 590) |

结论:对于日均决策频次>500次的中高频策略,本地化硬件投入6-8个月即可收回成本,且获得零数据泄露风险与亚毫秒级延迟的竞争优势。

结语:多智能体交易的"本地脑"时代

TradingAgents代表了AI在金融领域的新范式——不是更强的单一大脑,而是更协作的专家团队。当四位AI分析师、多空辩论员、风控经理同时在您的机箱内"头脑风暴"时,传统的云端串行调用已无法满足实时性与保密性的双重诉求。

西安坤隆UltraLAB推出的金融智能体工作站系列,专为LangGraph多智能体框架优化,以大显存、高并发、低延迟、金融级稳定四大特性,为量化研究员打造真正私有的"AI投研军团"。

本文技术架构基于TradingAgents开源项目(GitHub 39,685 Stars)与LangGraph框架,硬件方案由UltraLAB实验室实测验证,适用于A股/美股/加密货币多品种量化策略开发。

: TradingAgents: Multi-Agents LLM Financial Trading Framework, GitHub, 2026.

UltraLAB图形工作站供货商:

西安坤隆计算机科技有限公司

国内知名高端定制图形工作站厂家

业务电话:400-705-6800

咨询微信号:xasun001

上一篇:没有了