AI原生工程师装备指南:从Agent编排到全栈开发的算力重构

时间:2026-03-03 23:33:40

来源:UltraLAB图形工作站方案网站

人气:4032

作者:管理员

当"AI原生"成为工程师的标配标签,你的开发环境准备好了吗?

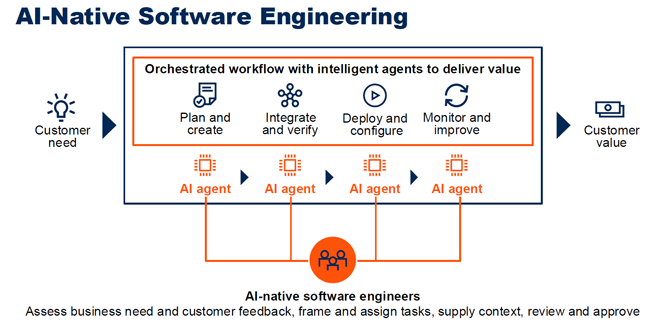

斯坦福大学讲师Mihel揭示了一个残酷现实:投出1000份简历只收到2个回复的初级工程师,与轻松驾驭多Agent工作流的前1%顶尖工程师之间,差距正在从"编程能力"转向"算力配置与工具链整合能力"。在Agent时代,硬件不再是被动承载代码的容器,而是主动参与智能编排的"硅基队友"。

一、Agent编排工作站:多智能体协同的算力底座

技术特征分析

AI原生工程师的核心战场是多Agent上下文切换管理。Mihel强调,顶尖工程师需要同时监控3-5个Agent的进度,并在它们之间无缝切换。这种工作模式对系统提出了独特要求:

-

高内存带宽:每个Agent实例需维护独立的上下文窗口(通常4K-128K tokens)

-

低延迟存储:Agent代码库的快速检索与版本切换(Agent-Friendly Codebase的实时验证)

-

并行计算:多Agent同时调用LLM API或本地模型推理

软件系统清单

| 软件层级 | 工具组件 | 版本要求 | 操作系统 |

|---|---|---|---|

| Agent框架 | MetaGPT / AutoGPT / CrewAI | 0.7+ | Ubuntu 22.04 LTS / macOS 14+ |

| 编排中间件 | LangChain / LlamaIndex | 0.1.x | 跨平台 |

| 开发环境 | Cursor / Windsurf / VS Code | 最新版 | Windows 11 Pro / Linux |

| 容器化 | Docker Desktop + Kubernetes | 4.25+ | Linux内核5.15+ |

| 本地模型 | Ollama + Llama 3 / Qwen 2.5 | 0.3+ | 支持CUDA 12.x |

| 测试验证 | Pytest + GitHub Actions Runner | 7.x+ | 本地CI/CD环境 |

硬件配置推荐(Agent编排特化型)

配置代号: AgentMaster-Pro 定位: 多Agent并行开发与上下文管理 核心组件: CPU: AMD Ryzen Threadripper 7970X (32核64线程, 5.3GHz Boost, 144MB L3) 内存: 256GB DDR5-5600 ECC (8×32GB, 四通道) - 分配策略: 每个Agent容器预留16-32GB上下文缓存 存储架构: - 系统层: 2TB PCIe 5.0 NVMe (读取14GB/s, 代码库快速冷启动) - 数据层: 4TB PCIe 4.0 NVMe (热数据, Agent工作区) - 归档层: 8TB HDD (版本历史与训练数据) GPU加速: NVIDIA RTX 4090 24GB (本地LLM推理) - 并发能力: 同时加载4-6个7B参数模型实例 - 量化支持: INT4/INT8精度,提升上下文吞吐量 网络: 双2.5Gbps以太网 (多Agent云端API并发调用) 显示: 双27寸 4K IPS (多窗口上下文监控) 散热: 360mm AIO水冷 ( sustained全核4.8GHz )

配置逻辑:32核64线程允许同时运行8-10个Agent进程而不发生上下文切换延迟;256GB内存支持在本地加载32K上下文长度的70B级别模型(Q4量化);PCIe 5.0 SSD确保在Agent频繁重写代码时,IDE索引与语法检查零等待。

二、Agent友好型代码库构建:测试驱动开发的硬件加速

技术特征分析

Mihel强调"测试是Agent运行的契约"。Agent友好型代码库需要具备:

-

快速反馈循环:Agent修改代码后,测试套件需在秒级完成验证

-

高IOPS存储:频繁的Git提交、分支切换、代码检索

-

内存密集型静态分析:TypeScript/Rust等语言的类型检查与Lint实时运行

软件系统清单

| 类别 | 工具 | 配置要点 |

|---|---|---|

| 版本控制 | Git + LFS | 大模型文件版本管理 |

| 代码质量 | ESLint / Prettier / Rust-analyzer | 实时语法检查 |

| 测试框架 | Jest / Pytest / Cargo test | 并行测试执行 |

| CI本地代理 | act (GitHub Actions本地运行) | Docker容器化验证 |

| 代码检索 | Sourcegraph Cody / ripgrep | 代码库语义搜索 |

| AI辅助 | GitHub Copilot + Sonnet 3.5 | 实时代码补全 |

硬件配置推荐(代码库构建型)

配置代号: CodebaseGuardian-Elite 定位: 大型代码库维护与Agent驱动重构 核心组件: CPU: Intel Core i9-14900KS (24核32线程, 6.2GHz单核睿频) - 关键优势: 单核性能主导IDE响应速度,6.2GHz确保TypeScript编译秒级完成 内存: 128GB DDR5-7200 (4×32GB, XMP 3.0) - 低延迟模式: CL34时序,提升随机访问速度 存储系统 (RAID0加速): - 系统盘: 2× 2TB PCIe 4.0 NVMe RAID0 (读写12GB/s+) - 代码库: 专用1TB PCIe 5.0 NVMe (存放工作区,4K随机读1M+ IOPS) 显卡: NVIDIA RTX 4070 Ti SUPER 16GB - 本地Copilot替代: 运行CodeLlama-34B辅助代码审查 外设增强: - 键盘: 机械键盘 (快速重构快捷键) - 内存盘: 64GB RAM Disk (临时编译缓存,减少SSD磨损)

配置逻辑:针对Agent频繁修改导致的"意大利面条代码"问题,需要极致的单核性能在毫秒级完成语法检查与类型推断;RAID0双SSD消除编译等待时间;大内存允许将整个代码库(含Git历史)加载到RAM Disk进行瞬时检索。

三、AI实验与模型微调:从试错到迭代的算力基础设施

技术特征分析

Mihel提出的"实验精神"要求工程师每周都能用Claude等工具重构系统。这意味着:

-

GPU显存饥渴:LoRA微调、RAG向量数据库构建需要24GB+显存

-

混合精度计算:FP16/BF16训练与INT4推理的并存

-

数据流水线:大规模文本预处理与嵌入生成

软件系统清单

| 实验阶段 | 软件栈 | 配置要求 |

|---|---|---|

| 数据准备 | Python 3.11 + Pandas + Polars | 内存计算优化 |

| 向量数据库 | Milvus / ChromaDB / Pinecone-local | 嵌入存储 |

| 微调框架 | Llama-Factory / Unsloth / Axolotl | CUDA 12.1+ |

| 实验跟踪 | MLflow / Weights & Biases | 本地服务器部署 |

| 推理加速 | vLLM / TensorRT-LLM | 高并发吞吐 |

| Jupyter环境 | JupyterLab + VS Code Server | 远程开发支持 |

硬件配置推荐(AI实验型)

配置代号: ExperimentLab-GPU 定位: 本地化LLM微调与RAG系统构建 核心组件: CPU: AMD EPYC 9354 (32核64线程, 3.8GHz, 256MB L3) - 优势: 大缓存加速数据预处理,多核心支持数据加载流水线 内存: 512GB DDR5-4800 ECC REG (8通道) - 数据集缓存: 可驻留100GB+语料库进行实时检索增强 GPU集群: - 主卡: NVIDIA RTX 6000 Ada 48GB (单卡微调70B模型LoRA) - 辅卡: RTX 4090 24GB (推理分离,并发AB测试) - 互联: NVLink桥接 (模型参数快速同步) 存储架构: - 热存储: 3.84TB U.2 NVMe (数据集与检查点) - 冷存储: 16TB SATA SSD (实验历史归档) - 网络存储: 10GbE NAS (团队协作数据集) 系统: Ubuntu 22.04 Server + Lambda Stack (预装PyTorch/CUDA)

配置逻辑:48GB显存支持对Llama-3-70B进行QLoRA微调(4bit量化+LoRA);双卡配置允许同时进行模型训练(Ada)和推理验证(4090);512GB内存确保在构建RAG系统时,可向量化存储千万级文本块。

四、全栈AI应用开发:从原型到生产的统一工作站

技术特征分析

新一代AI工程师需要端到端交付能力:前端界面、后端API、AI逻辑、部署运维。Mihel所说的"品味"体现在技术栈的流畅整合:

-

多语言编译:TypeScript/JavaScript + Python + Rust的混合开发

-

实时预览:热重载与AI生成代码的即时渲染

-

容器编排:本地Kubernetes集群模拟生产环境

软件系统清单

| 开发层面 | 技术栈 | 部署方式 |

|---|---|---|

| 前端 | Next.js 14 / React + TypeScript | Node.js 20 LTS |

| 后端 | FastAPI / Django / Gin | Docker + UVicorn |

| 数据库 | PostgreSQL + Redis + Weaviate | Docker Compose |

| AI推理 | Python微服务 + ONNX Runtime | 独立GPU容器 |

| 监控 | Prometheus + Grafana | 本地K8s集群 |

| 设计 | Figma + Vercel v0 (AI生成UI) | 浏览器端 |

硬件配置推荐(全栈开发均衡型)

配置代号: FullStack-AI-Creator 定位: 端到端AI应用开发与快速原型验证 核心组件: CPU: Apple M3 Max (16核CPU + 40核GPU, 128GB统一内存) 或 Windows方案: Intel Core Ultra 9 285K + RTX 4080 SUPER 内存: 128GB统一内存 (Mac) 或 128GB DDR5 (PC) - 统一内存优势: CPU/GPU共享带宽,模型推理零拷贝 存储: 4TB NVMe SSD (Mac) / 2TB PCIe 5.0 (PC) - 要求: 足够容纳Xcode/Docker镜像/本地模型 显示: - 主屏: 32寸 6K (UI设计) - 副屏: 27寸 4K竖屏 (代码阅读) 特殊配置: - Mac: 支持本地CoreML加速与iOS模拟器 - PC: 支持CUDA生态与Windows/Linux双系统五、成本效益与升级路径

| 发展阶段 | 推荐配置 | 核心投入点 | 预期产出效率 |

|---|---|---|---|

| AI学徒 (0-1年) | MacBook Pro M3 Pro 36GB | 内存容量、SSD速度 | 单Agent工作流,代码生成效率提升3倍 |

| 独立开发者 (1-3年) | 32核Threadripper + 64GB + RTX 4070 | GPU显存、多核CPU | 多Agent编排,项目交付周期缩短50% |

| 技术创业者 (3年+) | 双路GPU工作站 + 256GB内存 | 显存容量、存储IOPS | 自主模型微调,产品迭代速度超越团队 |

关键洞察:Mihel提到"新人比资深工程师更适合创业",因为他们更愿意尝试新工具。在硬件层面,这意味着不要过度配置,而是选择支持快速实验的弹性架构:

-

优先投资内存(Agent上下文缓存)和存储速度(代码库快速切换)

-

GPU选择遵循"显存优先于算力"原则(24GB是本地开发的甜点级)

-

保留PCIe插槽与电源余量,便于6个月后升级下一代AI加速卡

在这个Agent重构一切的时代,你的工作站不再是被动执行代码的工具,而是与你共同思考、实验、迭代的"硅基 pair programmer"。配置得当,它将成为你跻身前1% AI原生工程师的加速器。

【UltraLAB 解决方案事业部】

咨询专线:400-7056-800

微信号:xasun001